新闻中心back

阿里巴巴深夜宣布!

文章来源:阿里数字人才科创中心发布时间:2025-02-26 06:12:29浏览量:377次

2月25日深夜,阿里云视频生成大模型万相2.1(Wan)重磅开源,此次开源采用Apache2.0协议,14B和1.3B两个参数规格的全部推理代码和权重全部开源,同时支持文生视频和图生视频任务,全球开发者可在Github、HuggingFace、魔搭社区下载体验。

据悉,万相2.1在技术性能方面,展现出了碾压式的优势。在权威评测集VBench中,它以86.22%的综合得分傲视群雄,远超OpenAI的Sora等头部闭源模型。14B版本在处理复杂运动和物理规律模拟等场景时,表现尤为出色,甚至能够精准生成中英文特效文字视频,被誉为“首个理解中国风指令的模型”。而1.3B版本则以其惊人的显存效率和推理速度,仅需8.2GB显存即可在消费级显卡上生成480P视频,速度比同类模型快2.3倍,成为了“平民玩家的好莱坞制片厂”。

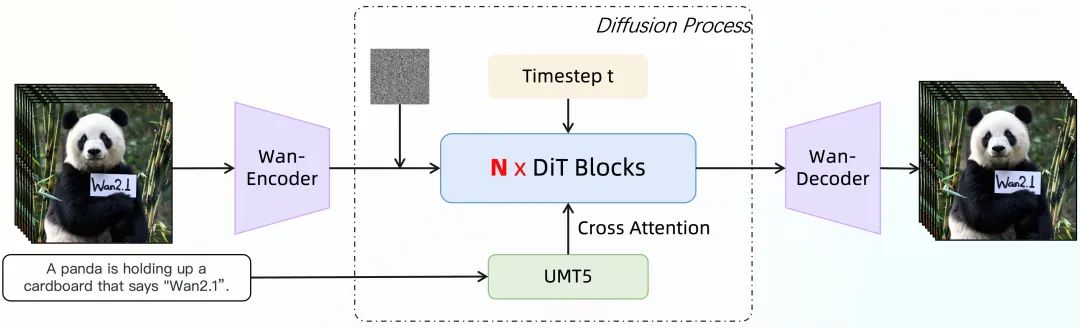

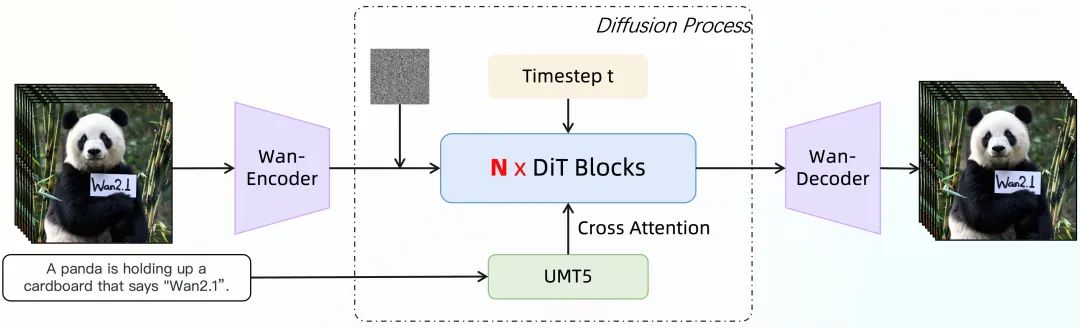

在关键技术方面,万相团队突破性地解决了长视频生成的难题。通过自研的因果3D VAE架构和特征缓存机制,实现了无限1080P视频的生成,彻底摆脱了显存的限制。同时,空间降采样压缩技术使得模型在保持画质的前提下,内存占用直降29%。此外,基于DiT架构的全局注意力机制,让生成的动作和物理效果更加逼真,堪比物理引擎。

万相视频模型架构图

万相视频模型架构图

此次开源不仅带来了代码和权重,阿里云还配套推出了Gradio体验、xDiT并行加速推理等工具链,支持Diffusers和ComfyUI生态。开发者们纷纷实测并给出好评,如“输入中文提示词后,10秒内即可生成视频,连水墨晕染的细节都能精准呈现”。结合阿里云此前开源的千问(Qwen)系列,其AI模型家族已全面覆盖语言、图像、视频等模态,衍生模型数量超过10万个,构建起了全球最大的开源生态。万相2.1的开源无疑给视频生成行业带来了地震级的影响。学术机构可以低成本地开展相关研究;短视频创作者能够实时生成带有双语特效的素材;甚至普通网友也能利用一张老照片让祖辈的肖像“动起来”上演小剧场。业内专家评论称:“阿里的这一波操作,不仅展示了其强大的技术实力,更是将视频生成从‘巨头游戏’转变为了全民皆可参与的狂欢。”

万相视频模型架构图

万相视频模型架构图